90万核、4万亿晶体管,晶圆级芯片再进化!英伟达竞品推出第三代,代码锐减97%,GPT-3训练仅需565行!

2024-03-14 11:39:32 EETOP致力于发展人工智能超级运算的公司Cerebras Systems,继2019 年推出全球最大的晶圆级处理器WSE、2021年推出第二代WSE-2 处理器后,近日又再次进化,推出了第三代晶圆级处理器WSE-3(Wafer Scale Engine 3 )以及由该款芯片构成的 CS-3 超级计算机系统。

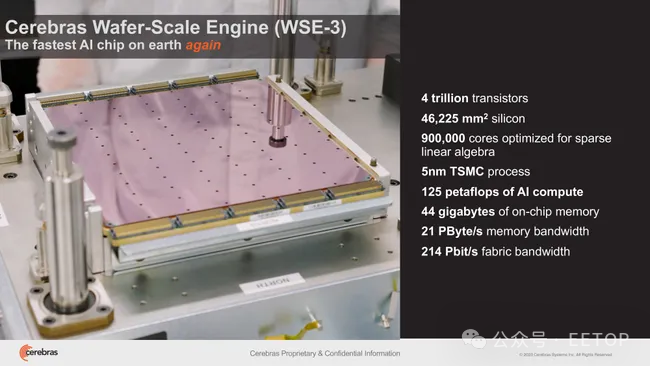

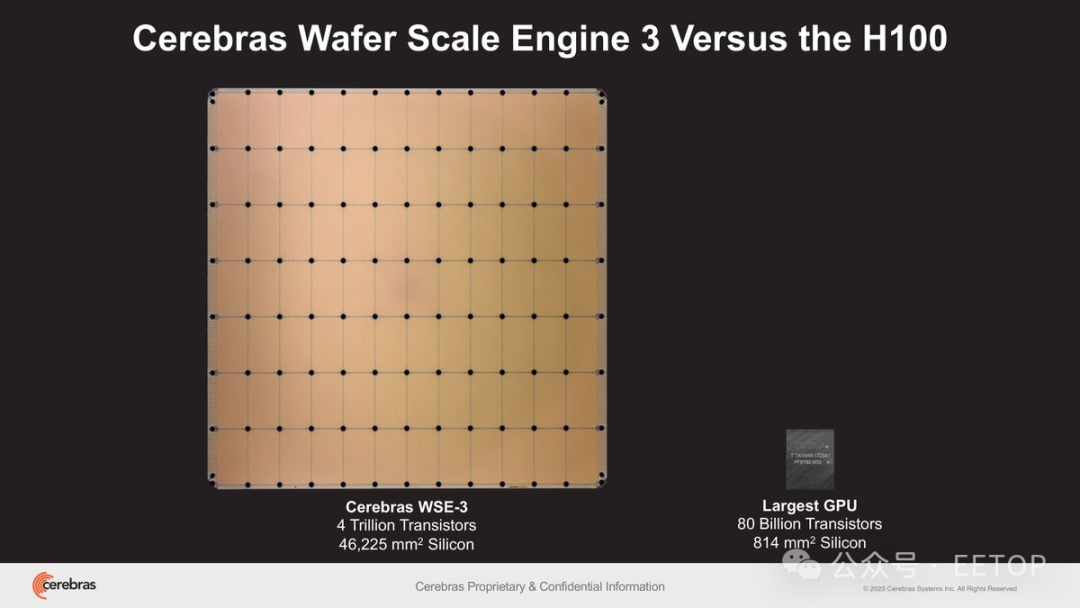

这是一款突破性的 AI 晶圆级芯片,其性能是其前身WSE-2的两倍。这款新器件采用了台积电5纳米工艺,包含 4 万亿个晶体管;90万个AI核心;44GB 片上 SRAM;峰值性能为 125 FP16 PetaFLOPS。Ceberas 的 WSE-3 将用于训练一些业界最大的人工智能模型。

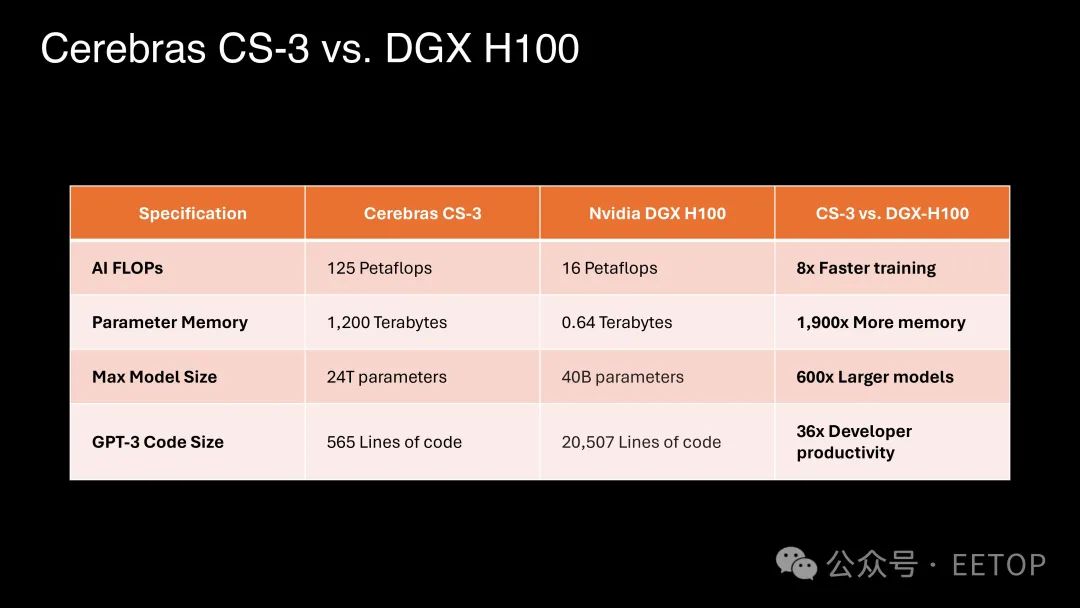

WSE-3 为 Cerebras 的 CS-3 超级计算机提供动力,该超级计算机可用于训练具有多达 24 万亿个参数的 AI 模型,这比由 WSE-2 和其他现代 AI 处理器提供动力的超级计算机实现了重大飞跃。该超级计算机可支持 1.5TB、12TB 或 1.2PB 外部存储器,这使得它可以在单个逻辑空间中存储海量模型,而无需分区或重构,从而简化训练过程并提高开发人员效率。

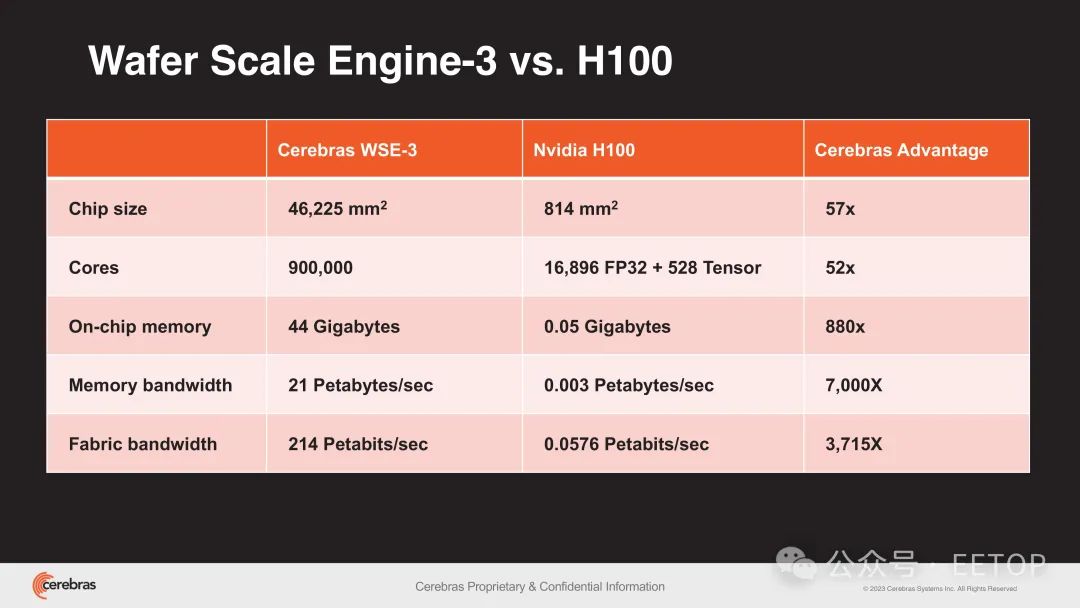

与英伟达H100比较

在可扩展性方面,CS-3可以配置为多达2048个系统的集群。这种可扩展性使其能够在一天内通过四系统设置微调 700 亿个参数模型,并在同一时间范围内从头开始全面训练Llama 70B 模型。

最新的 Cerebras 软件框架提供对 PyTorch 2.0 的原生支持,还支持动态和非结构化稀疏性,这可以加速训练——比传统方法快八倍。

Cerebras 强调了 CS-3 卓越的功效和易用性。尽管性能提高了一倍,CS-3 的功耗仍与其前身相同。它还简化了大型语言模型 (LLM) 的训练,与 GPU 相比,所需的代码减少了 97%。例如,据该公司称,GPT-3 大小的模型在 Cerebras 平台上只需要 565 行代码。

该公司已经看到了人们对 CS-3 的浓厚兴趣,并且拥有来自各个部门(包括企业、政府和国际云)的大量积压订单。Cerebras 还与美国阿贡国家实验室和梅奥诊所等机构合作,强调了 CS-3 在医疗保健领域的潜力。

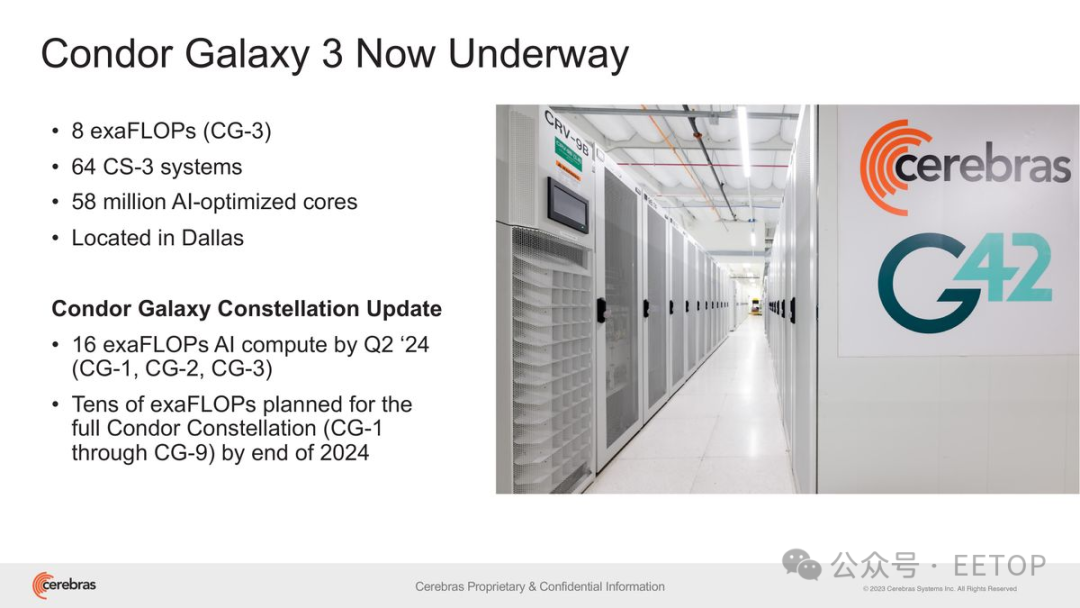

Cerebras 和 G42 公司之间的战略合作伙伴关系也将随着 Condor Galaxy 3 的建设而扩大,Condor Galaxy 3 是一款人工智能超级计算机,配备 64 个 CS-3 系统(包含多达 57,60万个内核)。两家公司已经共同创建了世界上最大的两台人工智能超级计算机:Condor Galaxy 1 (CG-1) 和 Condor Galaxy 2 (CG-2),它们位于加利福尼亚州,综合性能为 8 ExaFLOPs。此次合作的目标是在全球范围内提供数十 exaFLOP 的人工智能计算能力。

G42 公司首席技术官 Kiril Evtimov 表示:“我们与 Cerebras 的战略合作伙伴关系在推动 G42 创新方面发挥了重要作用,并将为加速全球范围内的人工智能革命做出贡献。Condor Galaxy 3 是我们的下一代 AI 超级计算机,拥有 8 exaFLOPs,目前正在建设中,很快将使我们系统的 AI 计算总产量达到 16 exaFLOPs。”