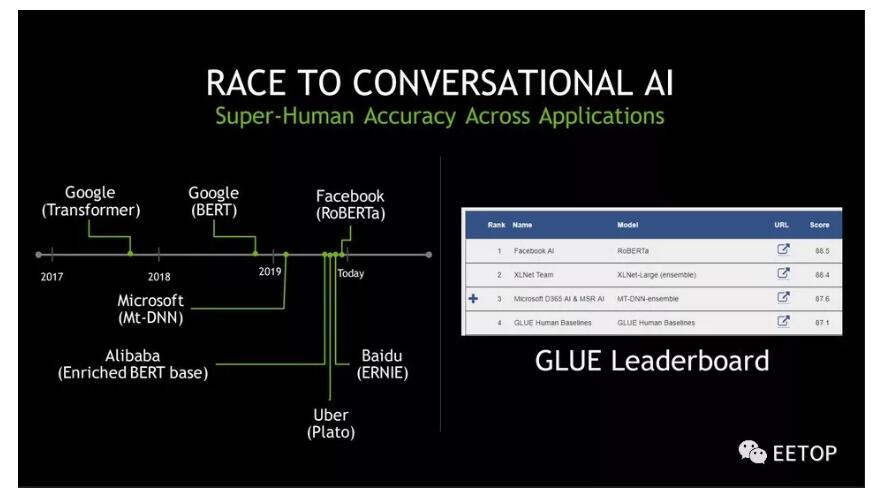

对话式AI 是不少科技大厂努力的方向,而零售业也高度期待的应用,能够快速的用人类习惯的口语对话方式回覆,不再只是冰冷的文字回覆。Nvidia 宣布目前最先进的AI 语音模型之一的BERT (Bidirectional Encoder Representations from Transformers),能用不到一小时的时间训练,AI 推论只要2 毫秒时间,对话式AI 可望能与人类有更即时的互动体验。

BERT AI 语音模型为Google 提出的模型,已经成为要追逐更短训练时间,更快AI 推论的人采用的AI 语音模型。这次Nvidia 突破先前训练时间的限制,成功推进至53 分钟完成训练,AI 推论则是2 毫秒时间,预计更有机会融入各项客户与零售的应用场景。

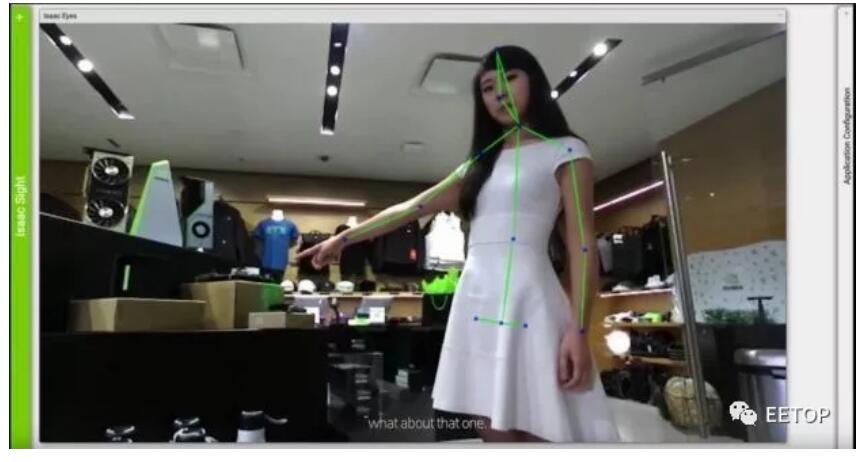

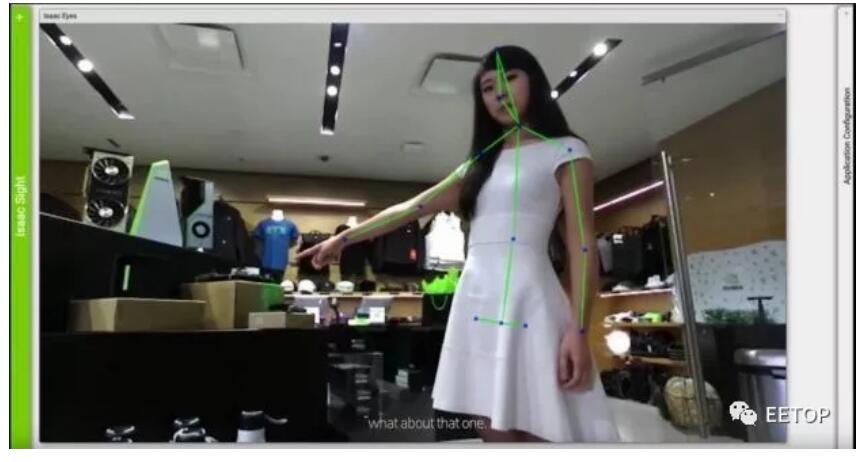

▲ 不少家业者开发新的对话式AI,想要实现更为贴近人类习惯的人机对话可能。

率先采纳Nvidia 先进效能成果的业者包括Microsoft 与许多全球最具创新力的新创公司,透过Nvidia 平台着手为其客户开发能即时反应的高度直觉化语言服务。微软选择在搜寻引擎Bing 采用Azure 云端平台与Nvidia 的硬体执行BERT AI 训练,用口语方式处理各项语音搜寻结果。

虽然有限度的对话式AI 服务已存在多年,然而发展至今,包括聊天机器人、智慧个人助理与搜寻引擎等服务想要以人类理解力的水准运作仍极为困难,主要原因是无法即时部署超大规模的AI 模型。Nvidia 透过在其AI 平台导入多项关键的优化技术借以解决这项问题,不仅在AI 训练与推论方面刷新速度纪录,同时也建构出至今最大的语言模型。

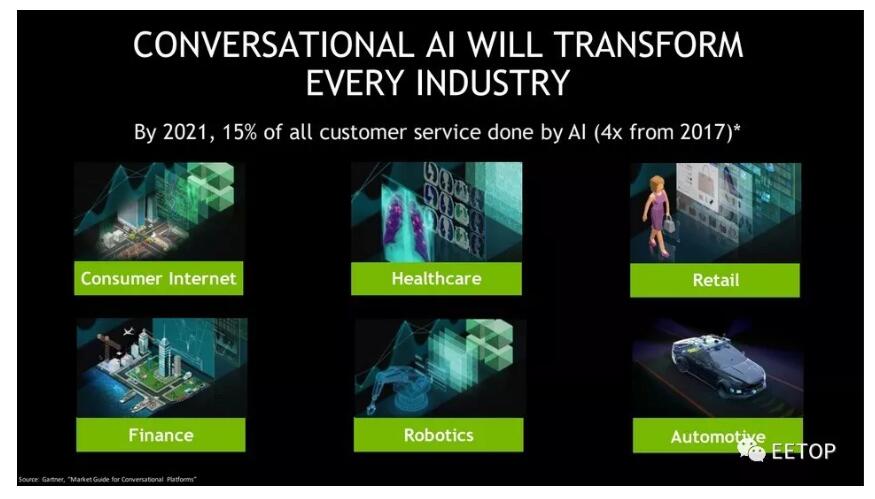

根据调研以及业者的预测,对话式AI 将在人类各个不同产业,如零售、金融、医疗、汽车、机器人和消费性网路市场带来重大影响。

Nvidia 深度学习应用研究部门副总裁Bryan Catanzaro 表示:「超大语言模型彻底颠覆自然语言AI。因为它解决许多极为困难的语意问题,往真正的对话式AI 迈进一步。Nvidia 的突破性成果除了加快这些模型,还让组织建构新型顶尖服务,以未曾想像的方式协助与满足客户。」

Nvidia 力助迈入新时代,藉由多项关键优化微调其AI 平台,创下三项新的自然语言理解效能纪录:

-

最快训练:采用内建由1,472 个Nvidia V100 GPU 组成92 个Nvidia DGX-2HTM系统的Nvidia DGX SuperPOD,执行全球最先进的AI 语言模型之一BERT 的大型版本,成功把BERT-Large 的训练时间从先前的数日大幅缩短至仅53 分钟。此外,Nvidia 也能透过仅一台Nvidia DGX-2 系统在2.8 天内就完成BERT-Large 的训练,展现Nvidia GPU 在对话式AI 领域的扩充性。

-

最快推论:Nvidia 以Nvidia T4 GPU 运行Nvidia TensorRT,在BERT-Base SQuAD 资料集上仅用2.2 毫秒就完成推论,不仅远低于许多即时应用要求的10 毫秒的处理门槛,也大幅领先以高度优化CPU 程式码执行的40 毫秒。

-

最大模型:针对开发者对于更大模型永无止境的需求,Nvidia Research 在Transformers 的基础上着手建构与训练全球最大的语言模型,并导入BERT 采用的技术元件,以及许多其他自然语言的AI 模型。Nvidia 的客制化模型拥有83 亿个参数,数量足足比BERT-Large 多出24 倍。

科技公司近年推出智慧音箱,无非是想要更为贴近使用者生活,各项服务能时时刻刻占据使用者生活,但要达成上述事项,必须要有够快的语音辨识技术,能够做到即时辨识与回应,才像是一般人对话的感觉,才有机会运用在客服或是各种不同的零售场景。Nvidia 能在BERT 语音模型训练取得突破,将有助于对话式AI 的普及。(来源:科技新报)

*免责声明:本文由作者原创。文章内容系作者个人观点,转载目的在于传递更多信息,并不代表EETOP赞同其观点和对其真实性负责。如涉及作品内容、版权和其它问题,请及时联系我们,我们将在第一时间删除!